Argomenti correlati

EuropaSorveglianza

Fondata nel 2017 dall’imprenditore australiano Hoan Ton-That e dal politico statunitense Richard Schwartz, Clearview AI è stata pioniera nel campo del riconoscimento facciale. Milioni di volti raccolti dalla rete ed elaborati dall’azienda con sede a New York hanno permesso alla società di offrire i propri servizi alle forze dell’ordine e ai servizi segreti di mezzo mondo.

Tuttavia, una tale raccolta di dati biometrici, indiscriminata e insensibile al consenso delle persone che finiscono registrate nel database di Clearview AI, si scontra con il regolamento per la protezione dei dati personali dell’Unione Europea e con i principi di minimizzazione del trattamento dei dati. Per questa ragione, secondo quanto appreso da IrpiMedia, da tre anni il Garante italiano per la privacy sta cercando di notificare all’azienda una sanzione da 20 milioni di euro, senza successo.

L’inchiesta in breve

- Da tre anni il Garante italiano prova a notificare all’azienda di riconoscimento facciale Clearview AI una sanzione da 20 milioni per violazioni del Gdpr, ma la società non ha sede in Europa e sfugge ai provvedimenti. Le sanzioni europee non riscosse nei confronti di Clearview AI superano i cento milioni di euro

- Clearview AI è ritenuta responsabile di aver raccolto miliardi di volti online senza consenso, offrendo il proprio sistema a polizie e agenzie governative in tutto il mondo

- L’assenza di una sede europea rende quasi impossibile far valere le sanzioni e verificare che Clearview AI abbia cancellato i volti dei cittadini europei dai propri sistemi, come prescritto dalle autorità garanti

- In alternativa a Clearview AI, proliferano servizi come PimEyes, che consentono ricerche facciali online a chiunque, anche in anonimato. Bastano pochi euro per cercare di risalire all’identità di una persona partendo da una banale fotografia

- Come PimEyes, anche altre aziende offrono il medesimo tipo di servizi, spesso in modo ancora più opaco. Ciò potrebbe favorire abusi della tecnologia. Il riconoscimento facciale è diventato accessibile a chiunque. E soprattutto economico

Il provvedimento dell’Authority risale ad aprile del 2022 e arriva a chiusura di un’istruttoria durata un anno. Similmente, altri Paesi europei – Francia, Olanda e Austria – si sono mossi contro Clearview AI per un totale di oltre cento milioni di euro di multe addebitate all’azienda statunitense. Ma Clearview AI non ha mai avuto una sede di rappresentanza nell’Unione Europea e ha preferito uscire dal mercato comunitario limitando l’offerta dei propri servizi a Paesi nei quali la raccolta indiscriminata di fotografie e dati biometrici di cittadini non costituisce un illecito.

Come vedremo, questo ha permesso a Clearview AI di schivare qualunque provvedimento e di non dover chiarire se abbia mai concretamente fatto qualcosa per rimuovere i volti di cittadini e cittadine europei dai propri server.

Tuttavia, la ritirata di Clearview dall’Ue non ha certamente eliminato il mercato delle tecnologie biometriche. Nuovi e più accessibili servizi di riconoscimento si offrono direttamente al mercato, consentendo a chiunque di poter fare le proprie ricerche passando al di sotto dei radar delle autorità per la privacy. Oggi una collaborazione tra IrpiMedia e la testata indipendente greca Solomon permette di mettere a fuoco questo fenomeno, in cui con pochi euro tutti possono improvvisarsi investigatori privati e mettersi a tracciare verosimilmente chiunque abbia mai avuto una propria foto pubblicata in rete.

Un iter complicato

L’esistenza di Clearview AI è nota al pubblico almeno dal gennaio del 2020, quando il New York Times ha pubblicato un’inchiesta intitolata La compagnia segreta che può mettere fine alla privacy come l’abbiamo sempre immaginata.

Nell’articolo viene rivelato come l’azienda offra i propri servizi a migliaia di dipartimenti di polizia statunitensi e all’Fbi. Per identificare un sospetto, un agente di polizia può interrogare il sistema di Clearview AI per cercare una corrispondenza tra un’immagine e il vasto database dell’azienda, che raccoglie i volti di miliardi di persone online (soprattutto pescati sui social network), senza il loro consenso.

Da quel momento il tema della protezione dei dati è entrato con forza anche negli Stati Uniti, mentre in Europa lo scandalo ha certamente contribuito alla stesura dell’AI Act, l’insieme di norme per la regolazione dell’intelligenza artificiale con cui si è puntato a garantire tecnologie sicure, etiche e rispettose dei diritti fondamentali dei cittadini europei, imponendo restrizioni più severe su applicazioni potenzialmente pericolose, come il riconoscimento facciale.

Come detto, per queste pratiche, Clearview AI ha accumulato sanzioni in Europa per un totale di cento milioni di euro per violazioni del Regolamento generale per la protezione dei dati personali (Gdpr). L’ultima in ordine cronologico è quella da 30 milioni di euro irrogata dall’autorità per la privacy danese, lo scorso settembre.

Ma la speranza di ottenere soddisfazione delle sanzioni emesse – e di accertare che l’azienda abbia concretamente rimosso il volto dei cittadini europei dal proprio archivio – sono molto flebili. In primis perché – come detto – la società non ha una sede di rappresentanza in Europa, nonostante l’obbligo sancito dal Gdpr. Inoltre perché notificare un atto amministrativo emesso in Europa nei confronti di un’azienda statunitense sembra pressoché impossibile.

La stessa autorità italiana ha tentato più volte di notificare il provvedimento. All’inizio via posta elettronica, anche se avrebbe dovuto sapere che gli Stati Uniti non hanno mai aderito alla Convenzione europea per la notifica dei documenti amministrativi all’estero. Come da prassi, il Garante si è rivolto allora al consolato italiano a New York per tentare la consegna di una raccomandata brevi manu, ma ben due tentativi sono falliti. Infine il Garante ha chiesto un parere all’Avvocatura dello Stato, che ha consigliato di rivolgersi a uno studio legale di New York per ottenere assistenza nella pratica. Era il marzo 2024.

Iscriviti alla newsletter mensile On the record per restare sempre aggiornato sul nostro giornalismo d’inchiesta

L’ostacolo sembra ancora insormontabile e lo ha recentemente confermato anche un rapporto redatto dal pool di esperti dello European data protection board (Edpb): le sanzioni dei garanti della privacy europei non sono applicabili alle aziende senza una sede legale in Europa. Anche se il Gdpr è stato pensato come regolamento applicabile extra-territorialmente, secondo quanto riportato nel report di Edpb, «nella maggior parte delle giurisdizioni vi è una regola consolidata secondo cui il diritto penale e fiscale di uno Stato estero e potenzialmente anche il diritto pubblico in generale non sono applicabili (in assenza di un trattato internazionale). Le sanzioni Gdpr rientrerebbero in questa categoria», si legge nel documento.

Per questa ragione gli esperti dell’Edpb hanno suggerito ai garanti della privacy europei di adottare un approccio diverso per contrastare le aziende tecnologiche che violano la protezione dei dati personali. «Gli Stati Uniti non riconoscono né eseguono sentenze straniere relative a tasse, multe o altre sanzioni», e le decisioni dei garanti non possono imporre «una sanzione o qualsiasi forma di punizione». Dunque il consiglio è quello di portare eventuali casi simili davanti a un giudice statunitense, chiedendo un risarcimento dei danni.

In passato i garanti olandese e irlandese avevano firmato un memorandum con la Federal trade commission, un’agenzia governativa statunitense che, pur non essendo un’autorità di protezione della privacy europea, si occupa della tutela dei consumatori negli Stati Uniti. Anche in questo caso però, come sottolinea l’Edpb nel report, «tali strumenti non sono giuridicamente vincolanti e la cooperazione è essenzialmente resa su base completamente volontaria». Un altro vicolo cieco.

Nel 2021 anche Buzzfeed News ha pubblicato una lunga inchiesta, rivelando che «88 forze dell’ordine e agenzie governative in ventiquattro Paesi al di fuori degli Stati Uniti» hanno utilizzato la tecnologia di Clearview AI. All’epoca, le ricerche effettuate dalle forze dell’ordine – talvolta senza l’autorizzazione dei loro superiori – attraverso prove gratuite del software della compagnia, ammontavano a 14mila in totale, coinvolgendo le autorità di Belgio, Regno Unito, Francia, Germania e anche Italia.

Secondo quanto riportato da Buzzfeed la polizia aveva effettuato 130 ricerche, probabilmente utilizzando un account di prova attivato durante una conferenza di settore in Europa. Ma a usare i prodotti di Clearview AI sarebbe anche l’Ambasciata statunitense a Roma, secondo un’inchiesta pubblicata da Mother Jones il 7 aprile scorso. Contattata via mail, la sede diplomatica non ha risposto a una richiesta di commento di IrpiMedia.

Ufficialmente l’unico software di riconoscimento facciale in uso alle forze dell’ordine del nostro Paese è Sari (Sistema automatico di riconoscimento immagini), come confermato a IrpiMedia dal dipartimento di Pubblica sicurezza in risposta a una richiesta di accesso agli atti su tutte le tecnologie di riconoscimento facciale impiegate dalle forze dell’ordine.

«Clearview AI e PimEyes – un altro software simile, ndr – o applicativi di analoghe tecnologie, basate su database raccolti con metodi di web-scraping (raccolta massiva di informazioni liberamente accessibili sul web, ndr), non sono mai state utilizzate dalla Polizia di Stato», si legge nella risposta.

Un sistema non scrutinabile

Sebbene nel maggio 2023, in un blogpost sul sito di Clearview AI l’azienda abbia affermato che il suo sistema è «progettato per casi di utilizzo governativi e di sicurezza pubblica, con amministratori designati dai clienti che esaminano l’attività degli utenti per garantire un utilizzo responsabile e corretto», la trasparenza e la correttezza delle operazioni effettuate dalle forze dell’ordine è demandata alla discrezionalità di queste ultime e può variare enormemente da Paese a Paese.

In Italia, ad esempio, il sistema di riconoscimento facciale Sari non è scrutinabile da giornalisti e organizzazioni non governative. Negli Stati Uniti la trasparenza sul funzionamento di sistemi di riconoscimento facciale è maggiore, ma a volte è il suo utilizzo a essere taciuto. In un articolo del Washington Post pubblicato nell’ottobre 2024, il giornale ha rivelato che la polizia statunitense dichiara raramente l’utilizzo di riconoscimento facciale durante le investigazioni, rendendo gli indagati incapaci di difendersi dalle accuse costruite attraverso le prove che scaturiscono dal sistema. Nell’articolo viene inoltre riportato un caso in Ohio, in cui gli agenti di polizia, utilizzando Clearview AI in un’indagine per aggressione, hanno trovato due corrispondenze particolari per il volto ricercato: una foto del cestista Michael Jordan e una vignetta raffigurante una persona nera.

Proprio PimEyes è tra le applicazioni online emerse negli ultimi anni per offrire un servizio efficace, affidabile e sostanzialmente aperto a chiunque paghi per effettuare ricerche basate sul volto di una persona. È sufficiente caricare una fotografia sul sistema per ricercare volti associabili tra quelli presenti in rete.

Sebbene il servizio sia disponibile a chiunque, a differenza di Clearview AI, anche PimEyes sembra guardare al mercato delle forze dell’ordine. Nel 2022 l’azienda ha dichiarato alla Bbc di aver iniziato alcuni negoziati «con le forze dell’ordine tedesche, italiane, britanniche e statunitensi» per l’utilizzo della sua tecnologia nel contrasto a crimini contro i minori, al terrorismo e al traffico di esseri umani. A una richiesta di IrpiMedia per conoscere l’evoluzione di questo dialogo con le forze di polizia italiane, l’azienda non ha fornito ulteriori delucidazioni.

La tecnologia non è neutrale: l’estremismo di destra di Hoan Ton-That

Il fondatore di Clearview AI è emigrato negli Stati Uniti a 19 anni, a San Francisco, dopo essere cresciuto in Australia. Sin dal suo arrivo nel Paese, secondo un’inchiesta del sito Mother Jones, Ton-That si sarebbe unito ai neo-reazionari della Silicon Valley in un movimento chiamato Dark Enlightenment, i cui membri considerano la tecnologia come strumento per modellare la società secondo idee discriminatorie nei confronti di minoranze etniche, religiose e donne.

Ton-That ha sostenuto l’allora candidato repubblicano Donald Trump nella festa la sera delle elezioni del 2016, indossando un cappellino con la scritta Maga (Make America great again, ndr). Nel tempo l’imprenditore ha cercato di avvicinare alcune personalità estremiste all’azienda: tra gli altri ci sono Hal Lambert, che gestisce la società di investimento Point Bridge Capital (che finanzia unicamente cause e candidati repubblicani, il Maga Etf), l’islamofoba Laura Loomer, l’artista di destra James O’Keefe e l’eugenetista danese Emil Kierkegaard, noto per aver sostenuto la legalizzazione della pornografia infantile e l’abbassamento dell’età per il consenso nei rapporti sessuali a 13 anni. Nel 2017 Ton-That ha per la prima volta parlato con i suoi soci di un sistema di riconoscimento facciale da offrire all’agenzia di frontiera statunitense, chiamato Smartcheckr, con l’intento di fermare l’immigrazione nel Paese.

Ora l’agenzia è tra i maggiori clienti di Clearview AI, che è il successore di quello strumento. Nello stesso periodo l’azienda aveva già ottenuto i finanziamenti del miliardario statunitense di destra Peter Thiel, conosciuto perlopiù per essere il fondatore di PayPal ma che è stato anche uno dei primi soci in affari dell’imprenditore ora a capo del Dipartimento dell’efficienza di governo, Elon Musk. Il primo cliente del sistema di riconoscimento facciale creato da Ton-That è stata JPMorgan Chase, multinazionale finanziaria con sede a New York che necessitava di un sistema per «controllare ogni persona che partecipava all’assemblea degli azionisti», garantendo che «non ci fossero manifestanti». Ton-That si era dimesso dal ruolo di presidente dell’azienda nel dicembre scorso e all’inizio di aprile è stato estromesso dalla guida di Clearview AI.

Come nasce un nuovo mercato

Torniamo indietro alla metà degli anni Dieci del 2000. In un contesto di rapida evoluzione tecnologica e crescenti necessità investigative, il campo della ricerca biometrica si perfeziona e affascina sempre di più. È il 2017 quando la polizia italiana si dota di Sari, capace di ricercare un volto tra i milioni di persone identificate e presenti nei database delle forze dell’ordine. Lo stesso anno vengono fondate Clearview AI e PimEyes.

In un certo senso, il servizio offerto da PimEyes è diventato nel tempo un’alternativa a Clearview AI, soprattutto dopo gli scandali e le sanzioni che hanno spinto la società fuori dal mercato europeo. La differenza principale è che PimEyes è orientato al grande pubblico e non solo alle sole forze di polizia, offrendo a chiunque la possibilità di utilizzare il software online dietro pagamento di somme relativamente contenute.

Sul sito ufficiale si legge che il servizio permette principalmente di cercare foto di se stessi e «gestire la propria presenza online», tuttavia offre dieci ricerche gratuite senza controllare che il volto caricato sia effettivamente quello dell’utente o di un’altra persona, secondo quanto emerso da alcuni test effettuati da IrpiMedia.

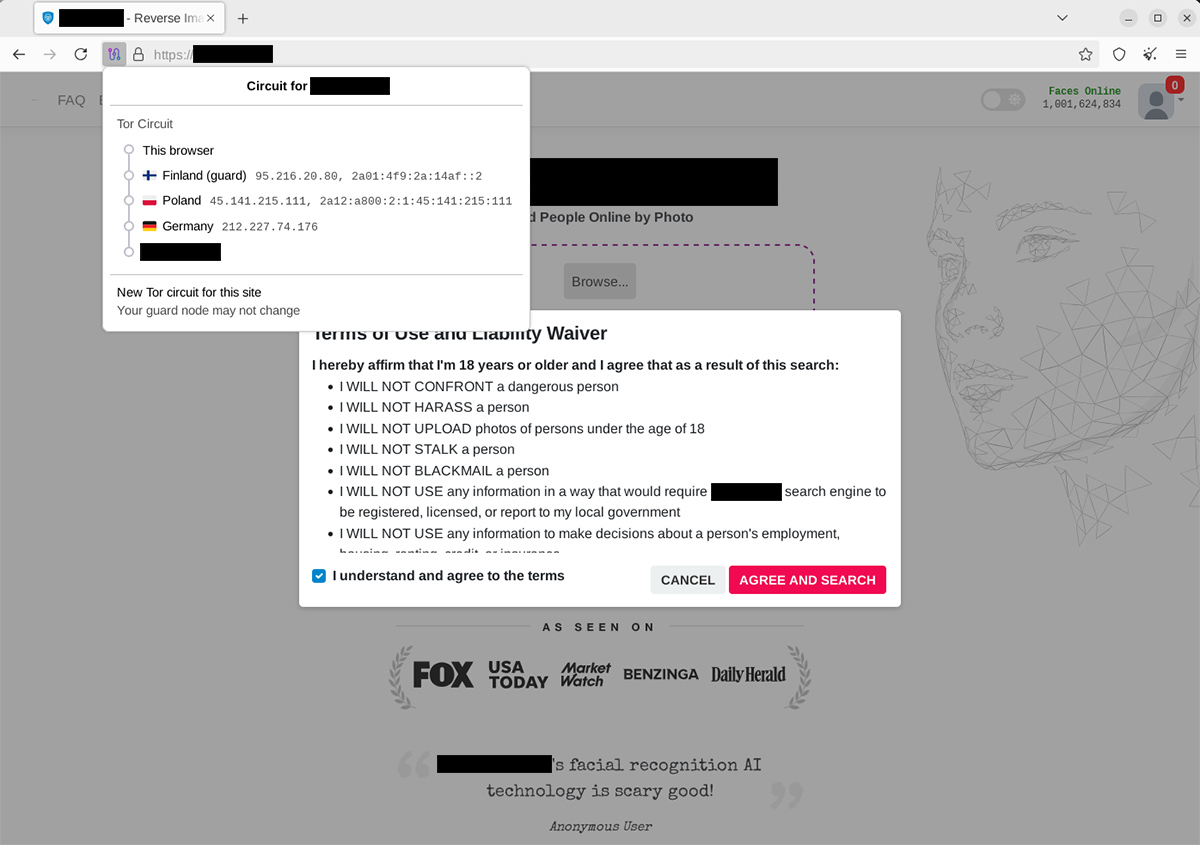

Accessibilità e costi irrisori (una ventina di euro per conoscere la lista dei siti e portali nei quali il volto ricercato è presente) ne fanno uno strumento perfetto per chiunque voglia fare qualche ricerca nella vita di altre persone. Formalmente il servizio sembra rivolgersi per lo più a chi si occupa di reputazione online o di copyright, dal momento che nei piani di abbonamento sono incluse opzioni per l’invio automatico di richieste di rimozione dei contenuti dai siti che finiscono nei risultati della ricerca. Tuttavia, anche qualche uso meno professionale sembra tollerato: come accertato da IrpiMedia, PimEyes è raggiungibile anche via Tor – browser che garantisce l’anonimato di chi naviga su Internet – rendendo verosimilmente irrintracciabile l’autore di una ricerca quantomeno fino a che non usa un metodo di pagamento tracciabile.

Contattata da IrpiMedia, l’azienda ha spiegato di aver sviluppato strumenti in grado di prevenire gli abusi, per esempio intercettando ricerche che coinvolgono immagini di bambini o verificando gli account email con i quali gli utenti si registrano. A quanto risulta a IrpiMedia, però, un account può essere registrato senza alcuna difficoltà utilizzando anche email temporanee e anonime. «Solo nell’ultimo anno abbiamo bannato oltre 1.100 account a causa dell’uso non autorizzato dei nostri servizi», chiarisce la società, senza specificare quali violazioni abbiano portato alla sospensione degli account.

Dai test effettuati da IrpiMedia, PimEyes risulta estremamente efficace, fornendo in modo puntuale un esaustivo elenco di risultati associati alla fotografia di partenza. Caricando una foto, IrpiMedia ha potuto constatare come il sistema riesca a distinguere il volto di una persona, isolandolo dal resto dell’immagine. È dunque innegabile che il sistema operi una specifica attività di analisi per individuare il volto contenuto in uno scatto. Il risultato è un elenco di risorse nelle quali foto della medesima persona sono reperibili online. Solo tramite pagamento è possibile conoscere l’indirizzo completo dei siti web sui quali le immagini sono state trovate.

«Non chiamatelo riconoscimento facciale»

Nonostante la precisione con la quale PimEyes è in grado di riconoscere e isolare il volto contenuto in una fotografia, l’azienda nega che si tratti di un trattamento biometrico.

«PimEyes è un motore di ricerca di foto, non un sistema di riconoscimento facciale», spiega un portavoce dell’azienda via mail. «Il fatto che la nostra azienda non elabori dati biometrici non è un’affermazione soggettiva, è un fatto tecnologico verificabile. Non stiamo discutendo di questioni astratte o filosofiche, stiamo affrontando chiare capacità tecnologiche. Pertanto, c’è poco spazio per le speculazioni: la tecnologia fa ciò per cui è stata creata e niente di più».

Secondo il pensiero di PimEyes, il fatto che il sistema restituisca un mero elenco di contenuti e non direttamente l’identità del soggetto ricercato dovrebbe bastare a dissociarla da altri sistemi come Clearview AI. Nei ripetuti scambi avuti con IrpiMedia, l’azienda ha insistito nel sottolineare che «poiché i dati biometrici sono intrinsecamente unici per ciascun individuo, il loro trattamento è direttamente collegato all’identificazione personale ed è quindi classificato come dato sensibile». Nonostante queste premesse, l’azienda continua a sostenere che la sua «piattaforma non ha l’obiettivo di identificare le persone. Il suo scopo è invece aiutare gli utenti a trovare siti web che potrebbero contenere immagini simili a quella che stanno cercando».

Di fatto, chiunque potrebbe scattare una foto in un locale o in una piazza affollata, ritagliare il volto di uno dei soggetti immortalati, sottoporlo a PimEyes e – se la ricerca produce risultati soddisfacenti – apprendere informazioni utili a identificare il soggetto senza alcun consenso. Esattamente il processo di identificazione utilizzato anche dalle forze dell’ordine, ma reso accessibile a chiunque e senza che vi sia un controllo sulle intenzioni dell’utilizzatore.

Per approfondire

«Sia Clearview AI sia PimEyes operano un riconoscimento facciale biometrico vietato in Europa», commenta l’avvocato esperto di diritto delle tecnologie Carlo Blengino, sottolineando come la pratica risulti illecita non solo secondo il Gdpr ma anche per la più ampia regolamentazione europea sull’intelligenza artificiale, l’AI Act. «Questa regolamentazione vieta i sistemi che creano o ampliano banche dati di riconoscimento facciale mediante scraping di immagini facciali da Internet», specifica l’esperto. Il motivo è presto detto: la sorveglianza di massa che ne deriverebbe potrebbe portare a gravi violazioni dei diritti umani fondamentali.

Difficile inoltre capire a cosa si riferisca l’azienda con quando parla di indicizzazione. «Non c’è nessun riferimento normativo che aiuti a definire tecnicamente in cosa consista l’indicizzazione di PimEyes, dato che il termine è usualmente riferito all’attività propria dei motori di ricerca, ma implica comunque, nel caso sia riferita a volti, un trattamento di dati personali. Quale che sia la tecnica utilizzata da PimEyes – con indicizzazione dei volti svolta manualmente, cosa improbabile, o con software che estraggono marker (indicatori o marcatori, ndr.) più o meno univoci –, è indubbio che un trattamento simile ricada giuridicamente nella stessa restrittiva regolamentazione propria dei sistemi di riconoscimento facciale», spiega ancora Blengino.

Sostienici e partecipa a MyIrpi

Regala l’adesione a MyIrpi+

e ricevi in omaggio la nostra T-shirt IrpiMedia.

Diventa una fonte.

Con IrpiLeaks puoi comunicare con noi in sicurezza.

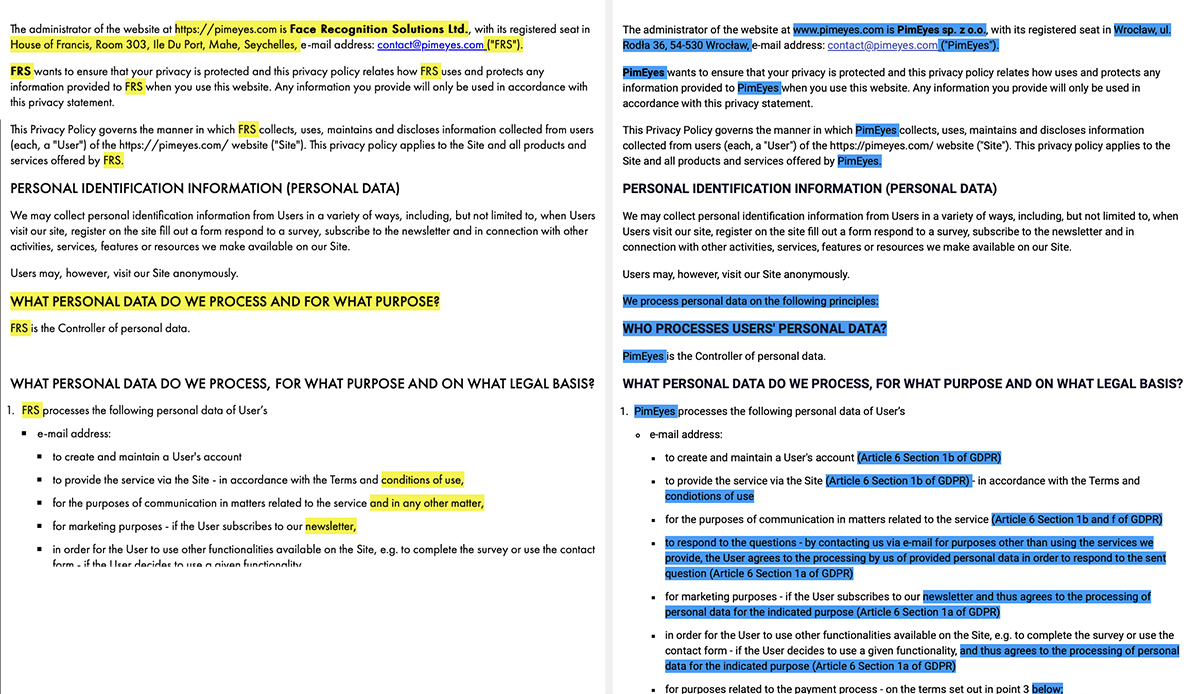

Insomma, nonostante l’azienda sia ferma sulla propria posizione, quello offerto da PimEyes sul mercato sembra un sistema del tutto simile a Clearview AI, che tratta dati biometrici senza consenso. In aggiunta a questo, quando il fondatore di PimEyes, Giorgi Gobronidze, ha lanciato il servizio con sede in Polonia, la privacy policy riportava un chiaro riferimento al trattamento di dati biometrici, così come richiesto dalla normativa europea Gdpr: «Al fine di eseguire il servizio ordinato, PimEyes elabora le immagini del volto dell’utente fornite dall’utente – la ricerca del volto viene effettuata mediante un’elaborazione tecnica specifica relativa alle caratteristiche fisiche di una persona fisica (elaborazione di dati biometrici), sulla base del consenso esplicito al trattamento dei dati espresso dall’utente prima di utilizzare il servizio», si legge risalendo alle precedenti versioni del testo ricavate tramite Wayback Machine.

Una volta passata di proprietà alla società Face Recognition Solutions Ltd, l’azienda ha spostato la sede centrale del sito web dalla Polonia alle Seychelles, un popolare paradiso fiscale. A partire da quel momento, i riferimenti al trattamento dei dati biometrici e alla regolamentazione Gdpr sono spariti.

In ogni caso, l’azienda fa sapere che «pur non trattando dati appartenenti a categorie particolari come definiti dal Gdpr, non essendo stabiliti nell’Unione Europea e non avendo l’Ue come mercato di riferimento, abbiamo adottato volontariamente una serie di pratiche conformi al Gdpr». Queste includerebbero il mantenimento di un ufficio dedicato alla protezione dei dati supervisionato da un Data protection officer, l’aggiornamento annuale della valutazione d’impatto sulla protezione dei dati (Dpia) e la revisione regolare delle politiche interne all’azienda.

Un’offerta sconfinata

È sufficiente una ricerca online per scoprire che in rete e alla portata di tutti vi sono decine di servizi simili a PimEyes, i quali spesso si presentano in modo ambiguo e senza preoccuparsi di avere una facciata legale che giustifichi l’uso del riconoscimento facciale che propongono. Uno di questi, trovato online da IrpiMedia e di cui si omette il nome per non incentivarne l’uso, non solo si propone come sistema in grado di trovare l’identità di una persona tramite «profili social media, apparizioni in blog, video e siti di notizie», ma anche di «confrontare la foto di una persona con milioni di volti diversi da fotografie segnaletiche, siti di reati sessuali».

Sul proprio sito, il servizio offre una pubblicità comparativa proprio con PimEyes, su cui afferma la propria superiorità in termini di risultati. La definizione del funzionamento del suo riconoscimento facciale appare molto simile a quella che PimEyes ha fornito a IrpiMedia: entrambi partono dal presupposto che il riconoscimento di un volto tra le milioni di persone in rete sia frutto di un’indicizzazione fotografica e non del trattamento di dati biometrici.

«In questo caso il problema è duplice – riprende l’avvocato Carlo Blengino – perché oltre a fare scraping di immagini ritraenti volti online, l’azienda dichiara di utilizzare anche foto segnaletiche e informazioni sui precedenti di una persona, che nel nostro Paese non sono un dato pubblico. Questo pone il sistema in contrasto con numerosissime regolamentazioni, soprattutto riguardo alla conservazione di dati giudiziari in banche dati». Una pratica che negli Stati Uniti è lecita, come dimostrato da un’inchiesta pubblicata dalla testata investigativa 404 Media, che ha rivelato come a partire dalla metà del 2019 l’azienda Clearview AI abbia speso milioni di dollari per acquistare foto segnaletiche e informazioni sugli arresti subiti da cittadini americani, da integrare poi nel proprio sistema di riconoscimento facciale.

A disposizione di chiunque e utilizzabile nuovamente tramite la navigazione anonima garantita da Tor, il servizio che si pone in concorrenza con PimEyes, testato da IrpiMedia, prevede pagamenti esclusivamente in criptovalute, il che complica ulteriormente la già difficile tracciabilità degli utenti del servizio, aprendo a concrete possibilità di abusi. La responsabilità dell’utilizzo del sistema è demandata all’utente finale che, a fondo pagina, è avvisato che il servizio è utilizzabile «solo per scopi educativi».

Sia l’azienda che controlla PimEyes, la Carribex Ltd, sia la compagnia dietro al sistema appena descritto risultano avere una sede in Belize. Il Paese è una meta prediletta per quegli imprenditori che vogliono operare al di fuori del luogo in cui registrano la loro attività, per usufruire di agevolazioni fiscali e di politiche particolarmente favorevoli in materia di segreto commerciale.

Le inchieste e gli eventi di IrpiMedia sono anche su WhatsApp. Clicca qui per iscriverti e restare sempre aggiornat*. Ricordati di scegliere “Iscriviti” e di attivare le notifiche.